免費(fèi)獲取專業(yè)評估與規(guī)劃

- 限額50個 -

歡迎光臨托普仕留學(xué)!

當(dāng)前位置:新加坡留學(xué)>留學(xué)資訊>新加坡國立大學(xué)開源NExT-GPT,助力AI發(fā)展

上傳時間:2023-11-29 16:46:15瀏覽量:841

助力ai發(fā)展,近期來自于新加坡國立大學(xué)的 NExT++ 實(shí)驗(yàn)室的華人團(tuán)隊(duì)率先開源了一款大一統(tǒng)通用多模態(tài)大模型“NExT-GPT”,它支持任意模態(tài)輸入到任意模態(tài)輸出。目前NExT-GPT的代碼已經(jīng)開源,并且上線了 Demo 系統(tǒng),下面就隨tops留學(xué)老師一起走近看看吧!

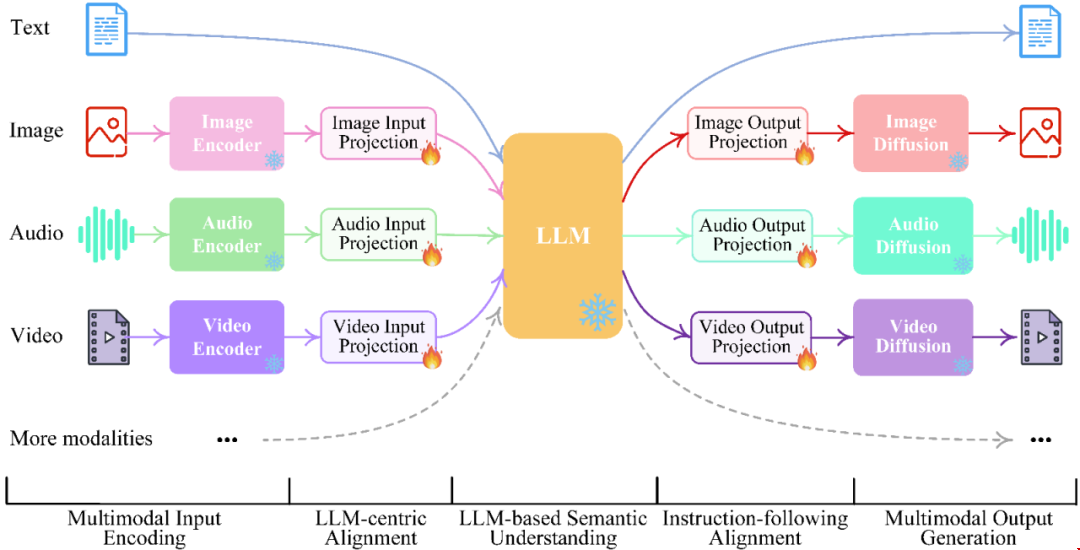

新加坡國立大學(xué)NExT-GPT主要架構(gòu)內(nèi)容:

NExT-GPT是新加坡國立大學(xué)開源的多模態(tài)語言模型,支持處理文本、圖像、視頻和音頻,為多媒體人工智能應(yīng)用提供強(qiáng)大支持。

采用三層架構(gòu),包括線性投影、Vicuna、LLM核心和模態(tài)特定的轉(zhuǎn)換層,通過MosIT技術(shù)進(jìn)行中間層訓(xùn)練。

(1)多模編碼階段:利用已開源的編碼器對各種輸入模態(tài)進(jìn)行編碼,然后通過一個投影層將這些特征投影為 LLM 所能夠理解的「類似語言的」表征。作者采用了 MetaAI 的 ImageBind 統(tǒng)一多模態(tài)編碼器。

(2)推理中樞階段:利用開源 LLM 作為核心大腦來處理輸入信息,進(jìn)行語義理解和推理。LLM 可以直接輸出文本,同時其還將輸出一種「模態(tài)信號」token,作為傳遞給后層解碼端的指令,通知他們是否輸出相應(yīng)的模態(tài)信息,以及輸出什么內(nèi)容。作者目前采用了 Vicuna 作為其 LLM。

(3)多模生成階段:利用各類開源的圖像擴(kuò)散模型、聲音擴(kuò)散模型以及視頻擴(kuò)散模型,接收來自 LLM 的特定指令信號,并輸出所對應(yīng)的模型內(nèi)容(如果需要生成的指令)。

據(jù)悉,模型在推理時,給定任意組合模態(tài)的用戶輸入,通過模態(tài)編碼器編碼后,投影器將其轉(zhuǎn)換為特征傳遞給 LLM(文本部分的輸入將會直接出入到 LLM)。然后 LLM 將決定所生成內(nèi)容,一方面直接輸出文本,另一方面輸出模態(tài)信號 token。如果 LLM 確定要生成某種模態(tài)內(nèi)容(除語言外),則會輸出對應(yīng)的模態(tài)信號 token,表示該模態(tài)被激活。

此外,文中作者指出,NExT-GPT 可能并不是實(shí)現(xiàn)任意模態(tài)輸入到任意模態(tài)輸出功能的首個工作。目前有兩類前驅(qū)工作:

一類是不久前所發(fā)布的 CoDi 模型,其整合了各種模態(tài)的 diffusion 模型,可以同時處理和生成各種組合的模態(tài)內(nèi)容。然而作者指出,CoDi 由于缺乏 LLMs 作為其核心部件,其僅限于成對(Parallel)內(nèi)容的輸入和生成,而無法實(shí)現(xiàn)復(fù)雜的內(nèi)容推理和決策,根據(jù)用戶輸入的指令靈活響應(yīng)。

另一類工作則試圖將 LLMs 與現(xiàn)有的外部工具結(jié)合,以實(shí)現(xiàn)近似的「任意多模態(tài)」理解和生成,代表性的系統(tǒng)如 Visual-ChatGPT 和 HuggingGPT。但作者指出,由于這類系統(tǒng)在不同模塊之間的信息傳遞完全依賴于 LLM 所生成的文本,其割裂、級聯(lián)的架構(gòu)容易不可避免地引入了噪音,降低不同模塊之間的特征信息傳遞效用。并且其僅利用現(xiàn)有外部工作進(jìn)行預(yù)測,缺乏一種整體的端到端訓(xùn)練,這對于充分理解用戶的輸入內(nèi)容和指令是不利的。

新加坡國立大學(xué)NExT-GPT兩大亮點(diǎn):

(1)低成本實(shí)現(xiàn)復(fù)雜推理 + 多模態(tài) in 和多模態(tài) out

NExT-GPT 完全基于現(xiàn)有開源的高性能模塊(比如目前性能最強(qiáng)的擴(kuò)散模型),充分站在巨人的肩膀上,以最低的成本實(shí)現(xiàn)大一統(tǒng)多模態(tài)大模型的構(gòu)建目標(biāo)(實(shí)驗(yàn)室可承擔(dān)級別的成本)。

(2)高效率端到端訓(xùn)練和模態(tài)對齊學(xué)習(xí)

妥當(dāng)?shù)摹⒍说蕉说南到y(tǒng)訓(xùn)練是 NExT-GPT 區(qū)別于現(xiàn)有其他組合型統(tǒng)一大模型系統(tǒng)最重要的一點(diǎn),也是保證 NExT-GPT 具有優(yōu)秀性能的前提。另一方面,還需要充分對齊系統(tǒng)中的所有模態(tài)的特征表征。為了既保證具有較好的學(xué)習(xí)成效,又全面降低、控制學(xué)習(xí)成本,本工作包含了以下的亮點(diǎn)。

新加坡國立大學(xué)NExT-GPT未來進(jìn)展空間:

基于NExT-GPT,后續(xù)的研究工作可以考慮以下幾個方面:

1.模態(tài)與任務(wù)擴(kuò)展:受限于現(xiàn)有資源,目前作者所開源的 NExT-GPT 系統(tǒng)僅支持四種模態(tài):語言、圖像、視頻和音頻。作者表示,后續(xù)會逐步擴(kuò)展到更多的模態(tài)(例如,網(wǎng)頁、3D 視覺、熱圖、表格和圖表)和任務(wù)(例如,對象檢測、分割、定位和跟蹤),以擴(kuò)大系統(tǒng)的普遍適用性。

2.考慮更多基座 LLM:目前作者實(shí)現(xiàn)了基于 7B 版本的 Vicuna LLM,其表示下一步將整合不同大小的 LLM,以及其他 LLM 類型。

3.多模態(tài)生成策略:目前版本的 NExT-GPT 系統(tǒng)僅考慮了基于擴(kuò)散模型的純輸出方式的多模態(tài)輸出。然而生成模式容易輸出錯誤幻想內(nèi)容(Hallucination),并且輸出內(nèi)容的質(zhì)量往往容易受到擴(kuò)散模型能力的限制。因此,進(jìn)一步提升擴(kuò)散模型的性能很關(guān)鍵,這能直接幫助提高多模態(tài)內(nèi)容的輸出質(zhì)量。另外,實(shí)際上可以整合基于檢索的方法來補(bǔ)充基于生成的過程的弊端,從而提升整體系統(tǒng)的輸出可靠性。

4. 降低多模態(tài)支持成本:可以考慮進(jìn)一步降低對更多模態(tài)的支持的成本。NExT-GPT 考慮了 ImageBind 來統(tǒng)一多種模態(tài)的編碼,從而節(jié)省了在編碼端的代價。而對于多模態(tài)輸出端,作者簡單地集成了多個不同模態(tài)的擴(kuò)散模型。如何防止隨著模態(tài)的增加而動態(tài)增加解碼器是后續(xù)的重要研究方面。比如可以考慮將一些支持不同模態(tài)生成(但具有模態(tài)共性)的擴(kuò)散模型進(jìn)行復(fù)用。

5. MosIT 數(shù)據(jù)集擴(kuò)展:目前 NExT-GPT 所使用的 MosIT 數(shù)據(jù)集規(guī)模受限,這也會限制其與用戶的交互表現(xiàn)。后續(xù)研究可以進(jìn)一步提升模態(tài)切換指令微調(diào)學(xué)習(xí)策略以及數(shù)據(jù)集。

以上是關(guān)于新加坡國立大學(xué)開源NExT-GPT的全部新聞,如果還想了解更多關(guān)于新加坡留學(xué)申請方面的相關(guān)知識的,歡迎隨時在線咨詢托普仕留學(xué)老師。托普仕留學(xué)多年名校申請經(jīng)驗(yàn)助力你的留學(xué)申請。

相關(guān)推薦:

相關(guān)推薦: